目录

- 1. 在 linux 服务器上部署 DeepSeek 模型

- 1.1 安装 Ollama

- 1.2 验证安装:

- 2. 下载模型

- 2.1 指定模式的安装目录

- 2.1.1 确定默认存储路径

- 2.1.2 设置新的下载路径

- 3. 配置远端 Web-UI 服务

- 3.1 配置防火墙

- 3.2 访问模型服务

- 3.3 使用Chatbox进行远程访问

出于对代码、文档等的保密要求,所以很多公司会将 DeepSeek 部署在本地服务器使用,如下是一个如何部署的保姆级的教程!我所使用的硬件环境如下所示。

Architecture: x86_64 CPU op-mode(s): 32-bit, 64-bit Byte Order: Little Endian CPU(s): 104 On-line CPU(s) list: 0-103 Thread(s) per core: 2 Core(s) per socket: 26 Socket(s): 2 NUMA node(s): 2 Vendor ID: GenuineIntel CPU family: 6 Model: 85 Model name: Intel(R) Xeon(R) Gold 6230R CPU @ 2.10GHz Stepping: 7 CPU MHz: 1000.761 CPU max MHz: 4000.0000 CPU min MHz: 1000.0000 BogoMIPS: 4200.00 Virtualization: VT-x L1d cache: 32K L1i cache: 32K L2 cache: 1024K L3 cache: 36608K NUMA node0 CPU(s): 0,2,4,6,8,10,12,14,16,18,20,22,24,26,28,30,32,34,36,38,40,42,44,46,48,50,52,54,56,58,60,62,64,66,68,70,72,74,76,78,80,82,84,86,88,90,92,94,96,98,100,102 NUMA node1 CPU(s): 1,3,5,7,9,11,13,15,17,19,21,23,25,27,29,31,33,35,37,39,41,43,45,47,49,51,53,55,57,编程客栈59,61,63,65,67,69,71,73,75,77,79,81,83,85,87,89,91,93,95,97,99,101,103 Flags: fpu vme de pse tsc msr pae mce cx8 apic sep mtrr pge mca cmov pat pse36 clflush dts acpi mmx fxsr sse sse2 ss ht tm pbe syscall nx pdpe1gb rdtscp lm constant_tsc art arch_perfmon pebs bts rep_good nopl xtopology nonstop_tsc cpuid aperfmperf pni pclmulqdq dtes64 monitor ds_cpl vmx smx est tm2 ssse3 sdbg fma cx16 xt编程客栈pr pdcm pcid dca sse4_1 sse4_2 x2apic movbe popcnt tsc_deadline_timer aes xsave avx f16c rdrand lahf_lm abm 3dnowprefetch cpuid_fault epb cat_l3 cdp_l3 invpcid_single intel_ppin ssbd mba ibrs ibpb stibp ibrs_enhanced tpr_shadow vnmi Flexpriority ept vpid ept_ad fsgsbase tsc_adjust bmi1 avx2 smep bmi2 erms invpcid cqm mpx rdt_a avx512f avx512dq rdseed adx smap clflushopt clwb intel_pt avx512cd avx512bw avx512vl xsaveopt xsavec xgetbv1 xsaves cqm_llc cqm_occup_llc cqm_mbm_total cqm_mbm_local dtherm ida arat pln pts pku ospke avx512_vnni md_clear flush_l1d arch_capabilities

1. 在 Linux 服务器上部署 DeepSeek 模型

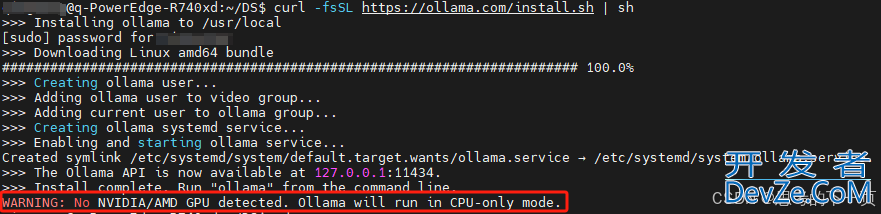

1.1 安装 Ollama

通过 “ Ollama” 进入其官网,点击 “Download” 进入下载界面,选择 Linux 操作系统,复制相关指令安装 Ollama,具体指令如下所示:

curl -fsSL https://ollama.com/install.sh | sh

如果服务器上没有显卡,那么安装结束后会出现如下的警告,无视即可。

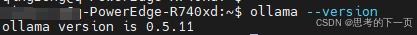

1.2 验证安装:

安装完成后,您可以通过以下命令验证 Ollama 是否安装成功:

ollama --version

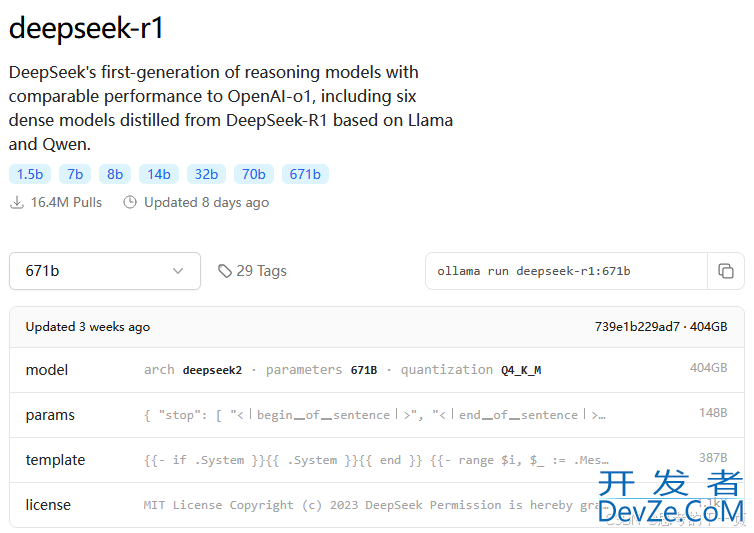

2. 下载模型

使用如下命令下载模型:

ollama run deepseek-r1:671b // 将下载并启动DeepSeek R1 671B模型

2.1 指定模式的安装目录

我们在安装模型时,可能由于服务器空间有限,需要安装到指定的目录。

2.1.1 确定默认存储路径

Ollama 默认的模型存储路径如下:/usr/share/ollama/.ollama/models (Linux)

2.1.2 设置新的下载路径

- 关闭Ollama进程:sudo systemctl stop ollama

- 打开终端,编辑Shell配置文件(如.bashrc、.zshrc):

- nano ~/.bashrc # 或使用其他编辑器

- 在文件末尾添加:

- export OLLAMA_MODELS="/data/ollama"

- 保存文件后,执行 source ~/.bashrc 使配置生效。

- 重启Ollama服务:sudo systemctl enable ollama

Note:

自定完如上目录后,启动ollama会失败,具体的原因为:ollama 用户和用户组对于/data/ollama目录没有访问权限,使用如下指令使能其权限。

# sudo chown -R ollama:ollama /data/ollama

3. 配置远端 Web-UI 服务

为了允许远程访问,您需要配置 Ollama 服务监听所有网络接口,并设置允许的来源。

编辑服务配置文件:sudo vim /etc/systejsmd/system/ollama.service,在文件中添加以下内容:

[Unit] Description=Ollama Service After=network-online.target [Service] ExecStart=/usr/bin/ollama serve User=ollama Group=ollama Restart=always RestartSec=3 Environment="OLLAMA_MODELS=/data/ollama" # 模型存储路径 Environment="OLLAMA_HOST=0.0.0.0:11434" # 允许远程调用 API Environment="OLLAMA_ORIGINS=*" [Install] WantedBy=default.target

上述配置将 Ollama 服务设置为在所有网络接口上监听 11434 端口,并允许所有来源的请求。

Note:

自定完如上目录后编程客栈,启动ollama会失败,具体的原因为:ollama 用户和用户组对于/data/ollama目录没有访问权限,使用如下指令使能其权限。

# sudo chown -R ollama:ollama /data/ollama

重新加载服务并启动:

sudo systemctl daemon-reload sudo systemctl enable ollama sudo systemctl start ollama sudo systemctl status ollama

3.1 配置防火墙

如果您的系统启用了防火墙,需要允许11434端口的访问: 允许端口访问:sudo ufw allow 11434

3.2 访问模型服务

完成上述配置后,您可以通过浏览器访问 http://<服务器IP>:11434 来验证服务是否正常运行。如果看到“Ollama is running”的提示,说明服务已成功启动。

3.3 使用Chatbox进行远程访问

为了方便与模型进行交互,您可以使用Chatbox客户端:

- 下载并安装Chatbox(Chatbox AI官网:办公学习的AI好助手,全平台AI客户端,官方免费下载):

- 访问Chatbox官网,下载适用于您设备的版本并安装。我选择的是网页版本:

- 配置API连接:

- 在Chatbox中,选择“Oandroidllama API”,并输入您的服务器IP和端口(例如http://<服务器IP>:11434)。

- 选择模型:

- 在模型列表中选择您下载的DeepSeek模型(如deepseek-r1:671b)。

- 开始对话:

- 配置完成后,您可以在Chatbox中输入问题,与模型进行交互。

到此这篇关于Linux 服务器本地部署 DeepSeek-R1 大模型!在远端Web-UI访问!保姆级教程!的文章就介绍到这了,更多相关Linux 本地部署 DeepSeek-R1 大模型内容请搜索编程客栈(www.devze.com)以前的文章或继续浏览下面的相关文章希望大家以后多多支持编程客栈(www.devze.com)!

加载中,请稍侯......

加载中,请稍侯......

精彩评论