目录

- 背景

- 过程

- 简单版本

- 改进

- 对比

- 总结

背景

最近公司需要用到一个Bert模型,使用这个模型对一个短文本做实时的encode(也就是编程客栈实现文本转换成向量)。

因为模型是基于python的transformers和sentence_transfromers。也就是只能使用python来做。

整体的数据流都是通过Java来调用,而python这端只需要提供文本www.devze.com转向量的接口即可。

因为之前就比较喜欢使用fastapi,而且fastapi也比flask快得多。因此将fastapi结合sentence_transfromers是再正常不过的了。

过程

简单版本

需要注意的是,这个代码是cpu密集型的,非常吃cpu的计算。

要想实现这样的一个功能,其实非常简单,创建一个python文件叫nlp_api.py,填写代码如下:

# 导入包

import numpy as np

import pandas as pd

import torch as t

from tqdm import tqdm

from fastapi import FastAPI

from fastapi.middl编程客栈eware.cors import CORSMiddleware

from sentence_transformers import SentenceTransformer as SBert

import uvicorn

from asgiref.sync import sync_to_async

import asyncio

# 加载模型

model = SBert("/home/dataai/文档/huzheng/模型部分/预训练模型/paraphrase-multilingual-MiniLM-L12-v2")

# 启动app

app = FastAPI()

# 让app可以跨域

origins = ["*"]

app.add_middleware(

CORSMiddleware,

al编程客栈low_origins=origins,

allow_credentials=True,

allow_methods=["*"],

allow_headers=["*"],

)

@app.get("/")

async def main():

return {"message": "Hello World"}

# 实现功能

@app.get('/get_vector_simple')

def sentenc2vector_simple(sentence):

"""

这里是提供文本转向量的接口,

:param sentence: 文本字符串

:return: 文本向量

"""

encode1 = model.encode(sentence)

encode1 = encode1.flatten().tolist()

return {'vector': encode1}

if __name__ == '__main__':

uvicorn.run(app='nlp_api:app', host="0.0.0.0",

port=8000, reload=True, debug=True)

运行这个代码也是非常简单,直接python运行即可:python nlp_api.py。

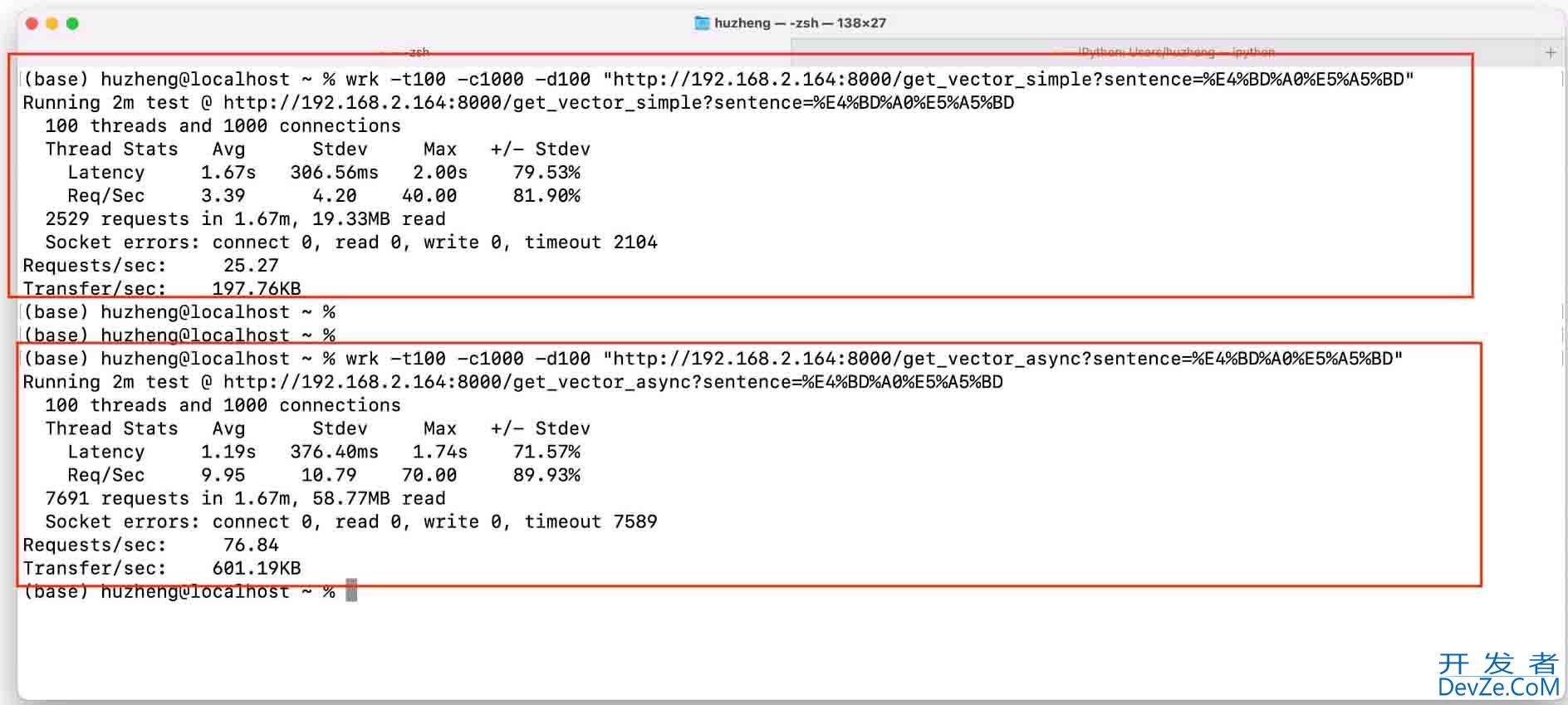

上面代码其实已经实现了这个功能。但是要对这个接口 做压测。这里使用的工具是wrk。我们设置了100个thread、1000个connection、时间是100秒。最终得到的结果是:

在1.67分钟内,接受了2529个请求;平均下来是每秒接受25.27个请求。这个时候我其实比较满意了。但是技术不满意,说这个太低了。

我使用htop查看了服务器的运行情况,发现cpu基本上都是吃满状态。负荷非常高。

改进

既然要考虑到每秒请求这么多的情况下,我用异步试一试。然后把上面的接口 做了异步处理。只要加上这个代码就行。

async def encode2list(encode):

return encode.flatten().tolist()

@app.get('/get_vector_async')

async def sentenc2vector_async(sentence):

"""

异步版本

这里是提供文本转向量的接口,

:param sentence: 文本字符串

:return: 文本向量

"""

encode1 = await sync_to_async(model.encode)(sentence)

encode1 = await encode2list(encode1)

return {'vector': encode1}

这个时候,就创建了一个异步接口。然后我又使用wrk。设置了100个thread、1000个connection、时间是100秒。测试这个接口,最终得到的结果是:

在1.67分钟内,接受了7691个请求,平均下来说每秒接受76.84个请求。

我把这个给技术,技术那边也基本是满意了。这样算下来,我平均一个句子转向量的时间大概需要13ms。这个其实已经非常高了。

对比

下图就是一个接口对比:

- 最上面的框是同步接口效率展示

- 最下面的框是异步接口效率展示

在这次cpu密集型中,异步接口的效率是同步接口效率的3倍。我后来又测试了几次,基本上都是在3倍以上。

在两种不同的接口下,我使用htop查看了cpu的运行情况:

- 同步接口被请求时,cpu负载情况:

- 异步接口被请求时,cpu负载情况:

可以看出来,相同的任务下,cpu的负载没有那么高,但是效率反而还提高了。

总结

这个模型400MB,底层基于python,使用了pytorch、transformers、Fastapi等包,实现了文本转向量功能,并且这个接口的效率可以达到每秒处理76条。折合每条的文本转向量的时间只需要13ms左右,我还是很开心的。起码不用去搞c++、TensorRT之类的东西。python yyds!!

但是我还没搞懂为什么在cpu密集型的这种任务下,异步接口效率比同步接口效率高这么多,而且还降低了cpu的使用率。

这条路走通,起码代表Fastapi一点也不差!!!我后面如果要开别的接口,可能都编程会用这种方式试一试。

numpy这种,以及Sbert模型其实都不能异步操作的,但是我使用了asgiref.sync,这个可以将非异步的转换成异步。非常方便。

作为Fastapi拥鳖,我还是很开心将他用在生产环境中。希望可以接受住考验!

以上为个人经验,希望能给大家一个参考,也希望大家多多支持编程客栈(www.devze.com)。

参考资料:

- https://stackoverflow.com/questions/49822552/python-asyncio-typeerror-object-dict-cant-be-used-in-await-expression

- https://github.com/UKPLab/sentence-transformers/issues/628

加载中,请稍侯......

加载中,请稍侯......

精彩评论